- A+

来源:机器之心

AGI 到底离我们还有多远?

在 ChatGPT 引发的新一轮 AI 爆发之后,一部分研究者指出,大语言模型具备通过观察进行因果归纳的能力,但缺乏自己主动推理新的因果场景的能力。相比于持乐观预测的观点,这意味着 AGI 仍然是一个复杂而遥远的目标。

一直以来,AI 社区内有一种观点:神经网络的学习过程可能就只是对数据集的压缩。

近日,伯克利和香港大学的马毅教授领导的一个研究团队给出了自己的最新研究结果:包括 GPT-4 在内的当前 AI 系统所做的正是压缩。

通过新提出的深度网络架构 CRATE,他们通过数学方式验证了这一点。

而更值得注意的是,CRATE 是一种白盒 Transformer,其不仅能在几乎所有任务上与黑盒 Transformer 相媲美,而且还具备非常出色的可解释性。

基于此,马毅教授还在 Twitter 上分享了一个有趣的见解:既然当前的 AI 只是在压缩数据,那么就只能学习到数据中的相关性 / 分布,所以就并不真正具备因果或逻辑推理或抽象思考能力。因此,当今的 AI 还算不是 AGI,即便近年来在处理和建模大量高维和多模态数据方面,深度学习在实验中取得了巨大的成功。

参数,可以得到强大且可解释的数据表征。

下面则给出了 CRATE 编码器架构的一层。其完整架构就是将这些层串连起来,再加上一些初始 token 化器、预处理头和最后的针对具体任务的头。

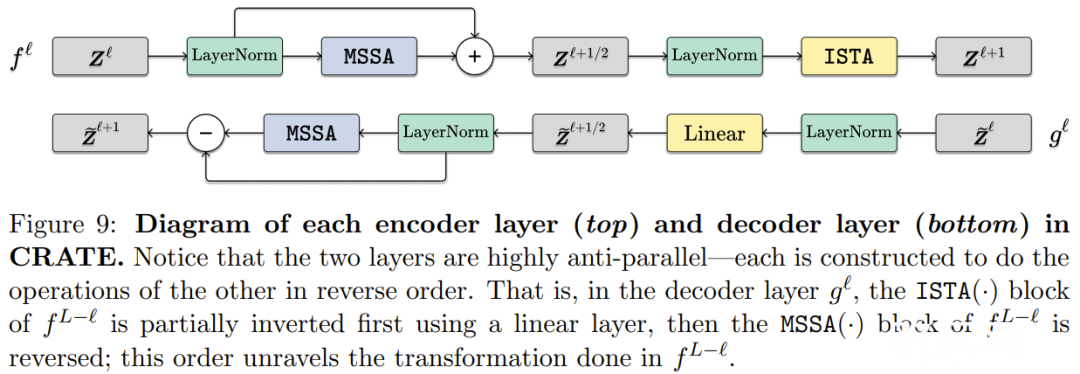

下图对比了编码器层和解码器层,可以看到两者是部分可逆的。

更多理论和数学描述请参阅原论文。

实验评估

为了证明这个框架确实能将理论和实践串连起来,他们在图像和文本数据上执行了广泛的实验,在传统 Transformer 擅长的多种学习任务和设置上评估了 CRATE 模型的实际性能。

下表给出了不同大小的 CRATE 在不同数据集上的 Top-1 准确度。

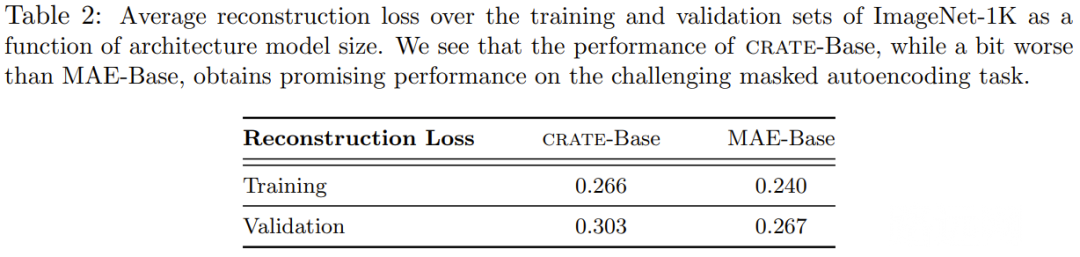

表 2 给出了 CRATE-Base 模型与 MAE-Base 模型在训练和验证集上的平均重建损失。

令人惊讶的是,尽管其概念和结构很简单,但 CRATE 在所有任务和设置上都足以与黑盒版的对应方法媲美,这些任务包括通过监督学习进行图像分类、图像和语言的无监督掩码补全、图像数据的自监督特征学习、通过下一词预测的语言建模。

此外,CRATE 模型在实践上还有其它优势,每一层和网络算子都有统计和几何意义、学习到的模型的可解释性显著优于黑盒模型、其特征具有语义含义(即它们可轻松用于将对象从背景中分割出来以及将其分成共享部件)。

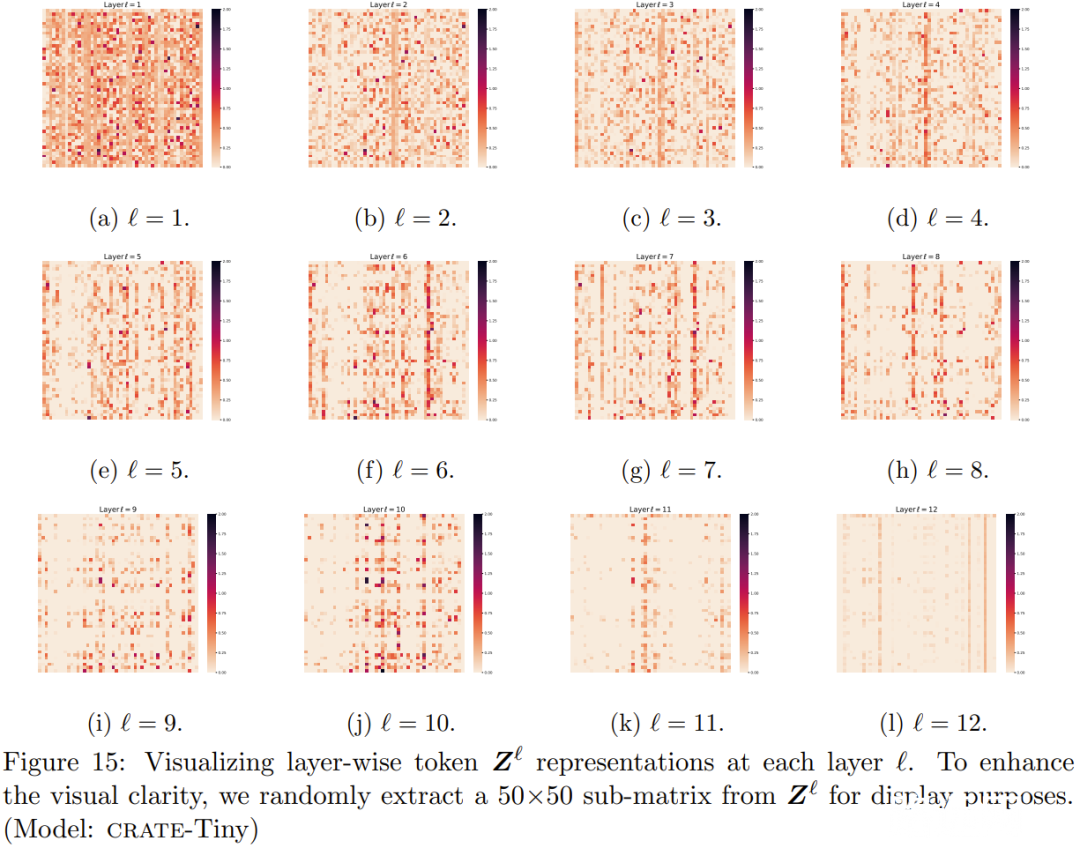

下图便给出了在每层 ℓ 的逐层 token Z^ℓ 表征的可视化。

下图展示了来自监督式 CRATE 的自注意力图。

注意由于资源限制,他们在实验中没有刻意追求当前最佳,因为那需要大量工程开发或微调。

尽管如此,他们表示这些实验已经令人信服地验证了新提出的白盒深度网络 CRATE 模型是普遍有效的,并为进一步的工程开发和改进奠定了坚实的基础。

- 我的微信

- 这是我的微信扫一扫

-

- 我的电报

- 这是我的电报扫一扫

-